Agence Data Engineering

Vos données sont inexploitées ?

On les rend fiables et actionnables

Vos équipes passent plus de temps à fiabiliser les données qu'à les exploiter ? Nous industrialisons vos pipelines avec une architecture medallion, des data contracts et une observabilité native — pour que chaque dashboard affiche les mêmes chiffres, partout, tout le temps.

Ils nous font confiance — 250+ projets livrés

Nos technologies Data Engineering

Python et SQL comme fondation, Airflow ou Dagster pour l'orchestration, dbt pour la transformation, Spark et Kafka pour le traitement distribué et le streaming, BigQuery ou Snowflake comme warehouse, DuckDB pour l'analytique embarquée, Delta Lake et Apache Iceberg pour le lakehouse — le tout déployé sur AWS ou GCP avec Terraform.

Python

Python Airflow

Airflow Dagster

Dagster dbt

dbt Spark

Spark Kafka

Kafka BigQuery

BigQuery Snowflake

Snowflake DuckDB

DuckDB Delta Lake

Delta Lake Iceberg

Iceberg PostgreSQL

PostgreSQL AWS

AWS Google Cloud

Google Cloud Docker

Docker Terraform

Terraform Fivetran

Fivetran Airbyte

Airbyte Great Expectations

Great Expectations+20 technologies data engineering maîtrisées

Nos cas clients en data engineering

Voir tous les cas clients ›

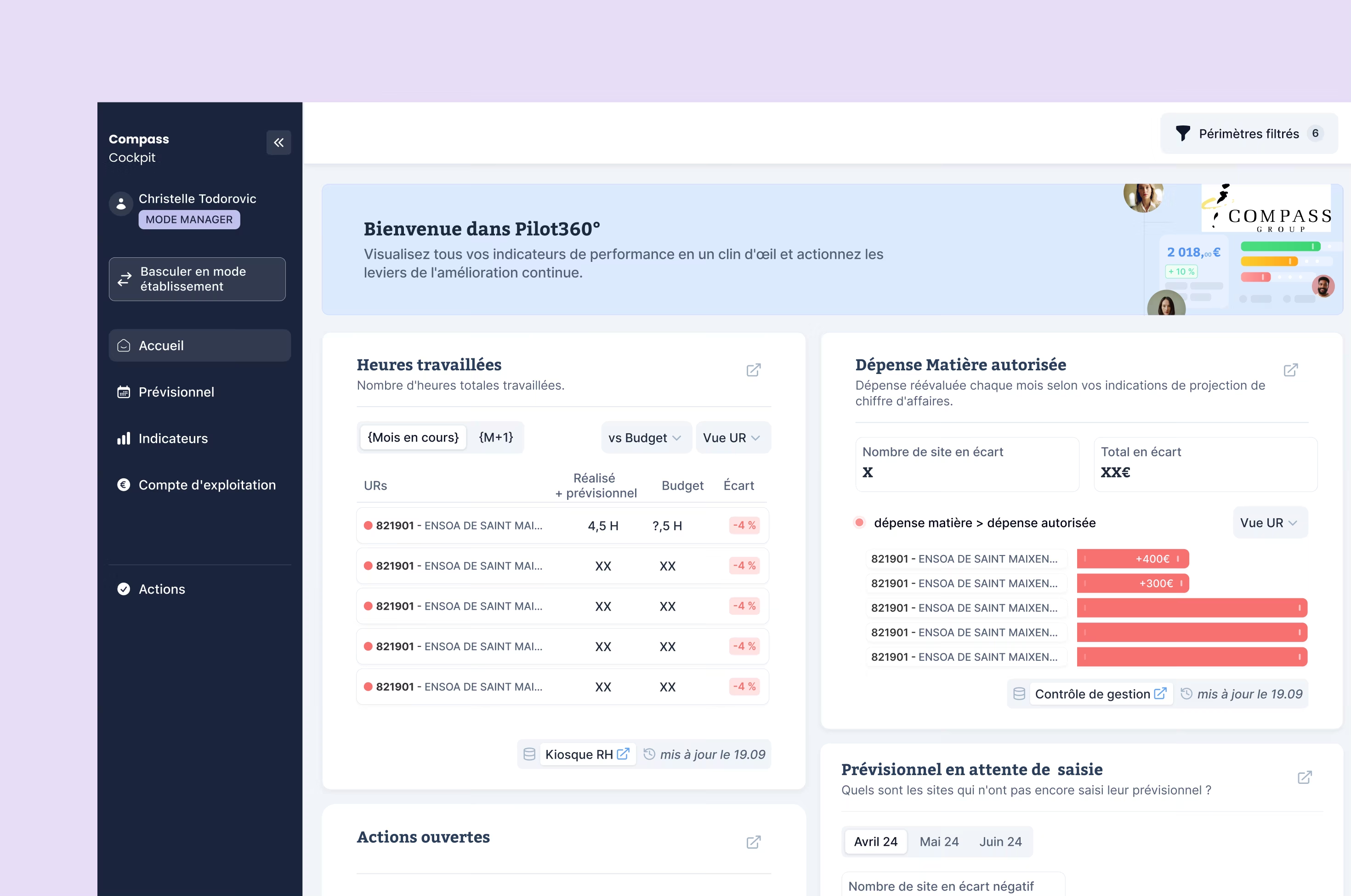

Compass Group

Unification des flux de données de 3 000 établissements en temps réel pour un leader mondial de la restauration collective (500 000 collaborateurs). Pipelines d'ingestion multi-sources, normalisation et data warehouse centralisé.

Voir le cas client ›

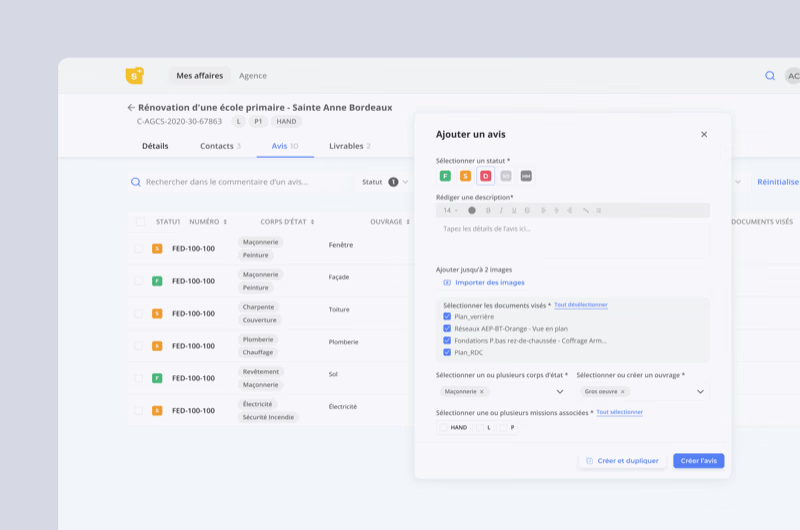

BTP Consultants

Automatisation complète des flux de données métier : ingestion de documents, transformation, enrichissement et exposition via API. Réduction de 95 % des coûts d'exploitation manuels.

Voir le cas client ›96% de nos clients continuent avec nous

“Ils ont eu énormément d’impact sur le traitement de la data.”

Julien GOUPIT, Directeur Innovation

Des pipelines qui tournent, pas des POC qui dorment

80 % des projets data échouent entre le POC et la production. Pas chez nous.

Nos ingénieurs data viennent de scale-ups et d'éditeurs SaaS où la donnée est critique : ils savent concevoir des pipelines idempotents, gérer le schema evolution sans downtime, et monitorer la freshness à la minute près. Chaque pipeline livré est versionné, testé, documenté et observable — prêt pour la nuit de garde comme pour l'audit RGPD.

Discutons de votre infrastructure data →Notre approche data engineering en 5 phases

Audit & Cartographie des sources

Inventaire de toutes vos sources de données (bases, API, fichiers, SaaS), évaluation de la qualité (complétude, fraîcheur, unicité), cartographie des flux existants et identification des quick wins.

1 à 2 semainesArchitecture & Pipeline pilote

Choix de l'architecture cible (medallion, data vault), du warehouse et de l'orchestrateur. Livraison d'un pipeline pilote de bout en bout — ingestion, transformation dbt, tests et exposition — pour valider les choix techniques.

2 à 4 semainesIndustrialisation itérative

Développement des pipelines source par source en sprints courts. Data contracts entre équipes, tests automatisés (dbt tests, Great Expectations), CI/CD et documentation vivante. Chaque sprint livre des données exploitables.

6 à 12 semainesObservabilité & Data Quality

Déploiement du monitoring : checks de freshness, volume et schema sur chaque dataset, alerting Slack/PagerDuty, SLA par dataset, runbooks d'intervention. Validation RGPD et audit des accès.

1 à 2 semainesTransfert & Évolution continue

Formation de vos équipes aux outils et pratiques DataOps, documentation complète, et accompagnement continu : nouvelles sources, optimisation des coûts cloud, et migration vers du streaming si le batch ne suffit plus.

Les problèmes data concrets que nous résolvons

Vous reconnaissez ces situations ? Ce sont les cas les plus fréquents sur lesquels interviennent nos ingénieurs data — avec des résultats mesurables en quelques semaines.

Vos dashboards affichent des chiffres différents

source unique de vérité absente, transformations dupliquées, logique métier éparpillée dans des scripts ? Nous posons une architecture medallion (bronze → silver → gold) avec dbt pour centraliser la logique de transformation et garantir la cohérence de bout en bout.

Vos pipelines cassent chaque lundi matin

pas de gestion du schema evolution, pipelines non idempotents, aucun retry automatique ? Nous concevons des pipelines robustes avec orchestration Airflow/Dagster, data contracts entre producteurs et consommateurs, et backfill automatisé quand une source change de format.

Personne ne sait d'où vient un chiffre

aucun lineage, pas de documentation des transformations, impossible de debugger un KPI ? Nous implémentons le data lineage de bout en bout, un data catalog avec métadonnées métier, et une documentation vivante générée automatiquement depuis dbt.

Vous découvrez les incidents data par vos utilisateurs

pas d'alerting sur la fraîcheur, la complétude ou les anomalies de volume ? Nous déployons une observabilité data native : checks de freshness, volume et schema à chaque run, alertes Slack/PagerDuty avant l'impact métier, et SLA formalisés par dataset.

Vivez enfin une expérience client 5✦ sans risque et garantie

La croissance fulgurante d’une agence de développement web & mobile autofinancée

Voir la parution ›

Interview de Cyrille ADAM, Co-fondateur de Yield Studio, sur le développement de l’agence

Voir la parution ›

Si l’App Store a trop de concurrents, les utilisateurs risquent de se perdre

Voir la parution ›

Développement logiciel : les entreprises sont à la ramasse et ça coûte (très) cher

Voir la parution ›

Le pari réussi des développeurs séniors à l’ère de l’IA

Voir la parution ›

L’IA contraint les équipes tech à se réorganiser, et c’est une opportunité

Voir la parution ›Découvrez nos articles sur la thématique Data & Infrastructure

Voir tous nos articles ›Nos expertises en Data Engineering

Audit & Architecture — poser les fondations qui tiennent

Cartographie & Audit — inventaire exhaustif de vos sources (bases SQL, API, fichiers, SaaS), évaluation de la qualité (complétude, fraîcheur, unicité) et identification des quick wins à fort ROI. Architecture cible — conception d'une architecture medallion (bronze/silver/gold) ou data vault selon votre contexte, choix du warehouse (BigQuery, Snowflake, Redshift) et de l'orchestrateur (Airflow, Dagster). Data modeling — dimensional modeling, gestion des Slowly Changing Dimensions (SCD), définition des grain et des conventions de nommage pour un patrimoine data lisible et maintenable.

Industrialisation — du premier pipeline à la plateforme data

Pipelines ELT modernes — ingestion avec Fivetran/Airbyte ou connecteurs custom, transformation avec dbt (modular, testé, versionné), orchestration avec Airflow ou Dagster pour des DAGs idempotents et observables. Data contracts & gouvernance — schémas versionnés entre producteurs et consommateurs, breaking change detection, data catalog et ownership clairement définis. CI/CD data — tests automatisés (dbt tests, Great Expectations), déploiement blue/green des transformations, et feature branches pour les pipelines comme pour le code applicatif.

Observabilité & Optimisation — garder le contrôle à grande échelle

Data observability — monitoring de la freshness, du volume et du schema sur chaque dataset critique, avec alerting contextuel (pas de faux positifs) et runbooks d'intervention. Cost engineering — optimisation des coûts cloud (partitioning, clustering, slot reservations BigQuery, warehouse sizing Snowflake) pour maîtriser la facture même quand les volumes explosent.

Scalabilité & évolution — intégration de nouvelles sources en self-service, migration progressive vers du streaming (Kafka, Pub/Sub) quand le batch ne suffit plus, et accompagnement sur les pratiques data mesh pour les organisations multi-équipes.

Nos experts à votre service

Questions fréquentes

Le data engineer construit l'infrastructure : il conçoit les pipelines d'ingestion, les transformations et le data warehouse pour que les données soient fiables, fraîches et accessibles. Le data scientist exploite ces données fiables pour entraîner des modèles prédictifs. Sans data engineering solide, les modèles de data science sont construits sur du sable — c'est pourquoi nous commençons toujours par poser les fondations data avant d'aller vers l'IA.

Un data lake sans structure devient vite un data swamp. L'architecture medallion (bronze → silver → gold) organise les données par niveau de maturité : bronze pour l'ingestion brute (append-only, immutable), silver pour les données nettoyées et conformées, gold pour les agrégats métier prêts à consommer. Chaque couche est testée indépendamment, le lineage est traçable de bout en bout, et on peut rejouer n'importe quelle transformation en cas d'incident.

C'est un des sujets les plus sous-estimés en data engineering. Nous implémentons des data contracts versionnés entre chaque producteur et consommateur de données. Quand une source change de schéma, la détection est automatique (schema checks à l'ingestion), le pipeline se met en pause proprement et alerte l'équipe — au lieu de propager silencieusement des données corrompues. Les migrations de schéma sont gérées comme du code : versionnées, testées et déployées progressivement.

La réponse dépend de votre SLA métier réel, pas de la hype. Si vos dashboards sont consultés une fois par jour, un batch quotidien avec Airflow et dbt suffit — et coûte 10× moins cher qu'une infra streaming. Le streaming (Kafka, Pub/Sub) se justifie quand le métier a besoin de données à la minute : détection de fraude, pricing dynamique, alertes temps réel. Nous concevons souvent des architectures hybrides : batch pour l'analytique, streaming pour les cas critiques.

Un premier pipeline pilote de bout en bout (ingestion → transformation → warehouse → exposition) démarre à 30 000 €. Une plateforme data complète avec multiples sources, orchestration, data quality et observabilité se situe entre 80 000 et 200 000 € selon la complexité. À cela s'ajoutent les coûts cloud récurrents (stockage + compute) que nous optimisons dès la conception — partitioning, clustering, warehouse auto-scaling — pour éviter les mauvaises surprises sur la facture.

Vos données méritent mieux que des scripts cron ?

30 minutes pour auditer votre stack data — gratuit, sans engagement.

Réserver un appel découverteAppel de 30 min → Audit data gratuit → Architecture cible sous 5 jours